巨頭“壟斷”算法的時代,結(jié)束了?

3 月 1 日,中國首個專門針對算法推薦的法規(guī)《互聯(lián)網(wǎng)信息服務(wù)算法推薦管理規(guī)定》正式執(zhí)行。

《規(guī)定》要求,算法推薦服務(wù)提供者需向用戶提供算法知情權(quán)、算法選擇權(quán)(便捷的關(guān)閉算法推薦服務(wù)的選項),以及,針對向未成年人、老年人、勞動者、消費者等主體提供服務(wù)的算法推薦服務(wù)提供者作出具體規(guī)范。

截至目前,微信、抖音、今日頭條、淘寶等App均已進(jìn)行了初步的改善,上線了算法推薦關(guān)閉鍵。

作為 21 世紀(jì)數(shù)字生活的主要生產(chǎn)力之一,算法憑借數(shù)據(jù)量的爆炸與算力的提升,漸漸蔓延至社會的各個領(lǐng)域,影響信息分發(fā)、商品等社會資源的配置、執(zhí)行自動化決策,無論在公共領(lǐng)域還是私人生活中,算法都是“強(qiáng)而有力”的存在。

從歡欣接受、感受其便利,到受其困擾、產(chǎn)生隱憂,算法如何“支配”我們的生活?用戶真的能夠放棄算法嗎?新規(guī)如何制約“算法”的不當(dāng)權(quán)利?相關(guān)法律法規(guī)經(jīng)歷了怎樣的發(fā)展?《規(guī)定》內(nèi)容是否會面臨實踐上的難題?

最近,我們分別與數(shù)字人文學(xué)者、互聯(lián)網(wǎng)治理研究員以及大廠的前算法工程師進(jìn)行了交流。

審視:算法如何

行使“權(quán)力”?

李大白:《算法的力量》

譯者,數(shù)字人文學(xué)者

社會秩序的協(xié)調(diào)、合作與控制離不開信息交換,而通過對大量數(shù)據(jù)的處理與應(yīng)用,算法已然成為了當(dāng)今社會信息交換的有效載體,因此,說“算法代表著一種權(quán)力”并不為過。

《算法的力量》一書的作者,英國學(xué)者、大律師杰米·薩斯坎德多年來一直關(guān)注數(shù)字技術(shù)對政治、經(jīng)濟(jì)和社會的影響。在書中,他描繪了數(shù)字技術(shù)對私人和公共生活的全面“入侵”,其中,“武力”、“審查”與“感知控制”則是算法行使“權(quán)力”的三種方式。

《算法的力量》杰米·薩斯坎德著

“武力”是指已經(jīng)編寫好的程序在執(zhí)行過程中無法被選擇或中止,人們只能服從于算法自動給定的結(jié)果。

2009 年,奧巴馬總統(tǒng)將 25 部美國經(jīng)典電影當(dāng)成禮物送給來訪的英國首相戈登·布朗。然而,布朗回到倫敦后,卻發(fā)現(xiàn)這些電影無法在他英國的 DVD 機(jī)上播放;原因是 DVD 制造商和發(fā)行商為了保護(hù)商業(yè)利益、實施版權(quán)法,將禁止播放的命令編成代碼寫到了 DVD 中,即便布朗已經(jīng)是英國最有權(quán)勢的人,面對算法設(shè)定的禁止指令也無能為力。

“審查”則主要是通過收集各項數(shù)據(jù),對人們的行動進(jìn)行監(jiān)控、預(yù)測以及規(guī)范。

譬如最近網(wǎng)絡(luò)爆出若干“算法系統(tǒng)監(jiān)控員工行為”、“算法預(yù)測員工離職幾率”的新聞,雖然相關(guān)互聯(lián)網(wǎng)公司已出面否認(rèn)這種說法,但這個事件本身就說明算法已經(jīng)越來越普遍地用于對人們的工作進(jìn)行測量與評估,甚至預(yù)測員工什么時候可能會離職,其結(jié)果是便是再現(xiàn)了福柯筆下“全景監(jiān)獄”的場景:員工們不得不時刻關(guān)注工作時間的上網(wǎng)行為。

關(guān)于算法對人們“感知控制”的討論要更多一些,核心概念有這些年常說的“信息繭房”和“過濾泡”,指的是算法能夠過濾信息、改變信息排序,進(jìn)而影響人們對于外界的感受與認(rèn)知。

人們接受的信息總是會受到某種“過濾”。在算法時代之前,過濾信息的職責(zé)主要由印刷品、廣播、電視等大眾媒體完成,如今,推薦算法在相當(dāng)程度上承擔(dān)了過濾的職責(zé),其代表就是 2012 年 8 月上線,主打個性化內(nèi)容推薦的今日頭條。一開始大家根本沒意識到它可能帶來的影響,然而基于興趣的算法推薦幾乎從根本上改變了內(nèi)容生產(chǎn)的邏輯。在其他領(lǐng)域,算法應(yīng)用的場景也逐漸豐富,電子商務(wù)、外賣平臺、打車軟件也紛紛采用更復(fù)雜的算法體系、做更多維度的服務(wù)匹配,徹底構(gòu)建起了以算法為主導(dǎo)的平臺社會。

一開始,因為算法能夠更精確、廣泛地控制人們傳遞和接受的信息,在其剛被應(yīng)用時受到用戶熱情追捧,所向披靡;然而,隨著“大數(shù)據(jù)殺熟”、“外賣騎手困在系統(tǒng)里”等負(fù)面問題的出現(xiàn),算法能“服務(wù)”人,但也能“利用”人的觀念也開始深入大眾。

國外的相關(guān)案例也不少。在 2016 年美國大選中,有學(xué)者發(fā)現(xiàn),機(jī)器人水軍“生產(chǎn)”了約 19% 的相關(guān)推文,為競選人拉票;同一年,英國脫歐公投時,Twitter上大約三分之一的流量來自自動程序,它們幾乎都站在脫歐的一方。很難說這些算法編寫而成的信息不會對人們的公共決策造成干擾。

算法越來越多地決定了誰被看到,誰被隱藏;誰入局,誰出局,哪些內(nèi)容會像病毒一樣傳播開來,哪些內(nèi)容注定無人問津。

今年 3 月開始實行的《互聯(lián)網(wǎng)信息服務(wù)算法推薦管理規(guī)定》中指出,用戶可以選擇關(guān)閉算法推送,這無疑是正當(dāng)?shù)模蚱錇橛脩粼谒惴ㄊ褂蒙咸峁┝吮匾摹巴顺鰴C(jī)制”,讓用戶有權(quán)利選擇是否接受算法對自我感知渠道的形塑。

問題是關(guān)閉之后用戶將看到什么內(nèi)容呢?

我在某內(nèi)容平臺上嘗試勾選“關(guān)閉個性化推薦”按鈕,隨后該平臺上呈現(xiàn)的內(nèi)容幾乎是無序的,無奈之下,我重新打開了“個性化推薦”。

如果說在算法主導(dǎo)內(nèi)容之前,我們看到的是編輯精選的優(yōu)質(zhì)內(nèi)容,那么在“算法”把關(guān)的情形下,沒有個性化推薦的信息流很可能既沒有營養(yǎng),也不能滿足用戶的閱讀需求。如果為了實現(xiàn)對算法推薦的自主選擇權(quán),要以損失優(yōu)質(zhì)的閱讀或使用體驗為代價,顯然是大多數(shù)人不愿意看到的。如果平臺抓住用戶的這一心理,對于關(guān)閉推薦算法的用戶“區(qū)別對待”,那么用戶也只能無奈放棄手中選擇的權(quán)利。

除了上述問題,由于算法在社會場景中越來越廣泛的應(yīng)用,也引發(fā)了人們對于算法是否公平、正義的質(zhì)疑。

2014 年,亞馬遜開發(fā)了一套簡歷篩選系統(tǒng),對過去 10 年的簡歷進(jìn)行關(guān)鍵詞識別并排序,結(jié)果是該系統(tǒng)對于男性應(yīng)聘者有著明顯的偏好;2015 年,谷歌更新其照片應(yīng)用的同時加入了一個自動標(biāo)簽功能,但卻被紐約的一位黑人程序員發(fā)現(xiàn),自己的照片竟然被打上了“大猩猩”的標(biāo)簽。

算法本身可能是“無罪”的,但是當(dāng)它抓取、學(xué)習(xí)的數(shù)據(jù)不完整、或帶有偏見時,歧視和不公正自然就內(nèi)嵌到算法之中了。我們很難要求每個算法工程師都是通曉道德哲學(xué)、社會政策的“哲人王”,實現(xiàn)相對公正的算法,需要政治、法律、人文、社會學(xué)等各個學(xué)科的共同參與。

治理:“規(guī)范”之網(wǎng)的歷史

方師師:上海社科院新聞研究所

副研究員、互聯(lián)網(wǎng)治理中心主任

數(shù)字化、數(shù)據(jù)化和可計算是進(jìn)入算法社會的門檻。通過各種量化和追蹤技術(shù),我們正在經(jīng)歷一個“數(shù)據(jù)盛世”。如何將這些數(shù)據(jù)有效、合理、創(chuàng)新地使用起來,就不僅僅是一個技術(shù)問題,還是一個社會問題。

在這方面,歐盟起步得比較早,他們在 2016 年發(fā)布的《通用數(shù)據(jù)保護(hù)條例》(GDPR)被稱為“史上最嚴(yán)格的隱私和數(shù)據(jù)保護(hù)法”。

其實早在 1995 年,歐盟就曾發(fā)布過數(shù)據(jù)保護(hù)指令,只不過當(dāng)時使用互聯(lián)網(wǎng)的人很少,個人數(shù)據(jù)的收集及處理僅限定在用戶名、地址及金融信息等方面。隨著移動互聯(lián)網(wǎng)的普及,這一指令的內(nèi)容已經(jīng)無法幫助歐盟應(yīng)對不斷出現(xiàn)的安全風(fēng)險。

于是從 2012 年起,歐盟委員會開始重新審視個人數(shù)據(jù)保護(hù)的法律準(zhǔn)則,逐步制定并完善了 GDPR。

同樣是在 2016 年,國內(nèi)出臺了《網(wǎng)絡(luò)安全法》,其中也提到了要加強(qiáng)對個人信息的保護(hù)。去年相繼發(fā)布的《數(shù)據(jù)安全法》和《個人信息保護(hù)法》也是對網(wǎng)絡(luò)數(shù)據(jù)和個人信息作出了專項規(guī)定。

但是在算法入侵的世界中,只對數(shù)據(jù)進(jìn)行規(guī)范是遠(yuǎn)遠(yuǎn)不夠的。

今年 3 月國內(nèi)開始執(zhí)行的《互聯(lián)網(wǎng)信息服務(wù)算法推薦管理規(guī)定》就針對“大數(shù)據(jù)殺熟”、“不正當(dāng)競爭”、“特殊人群保護(hù)”等社會關(guān)注的熱點問題給予規(guī)定明確。這是我國第一個專門針對算法推薦的規(guī)章制度,在世界范圍也是一個創(chuàng)舉,一定程度上代表了當(dāng)前對于算法技術(shù)治理的最前沿。

“規(guī)定”將堅持正能量、禁止推薦違法信息、落實主體責(zé)任等,列為算法推薦服務(wù)提供者最重要規(guī)范。對科技倫理的審查提上議程。

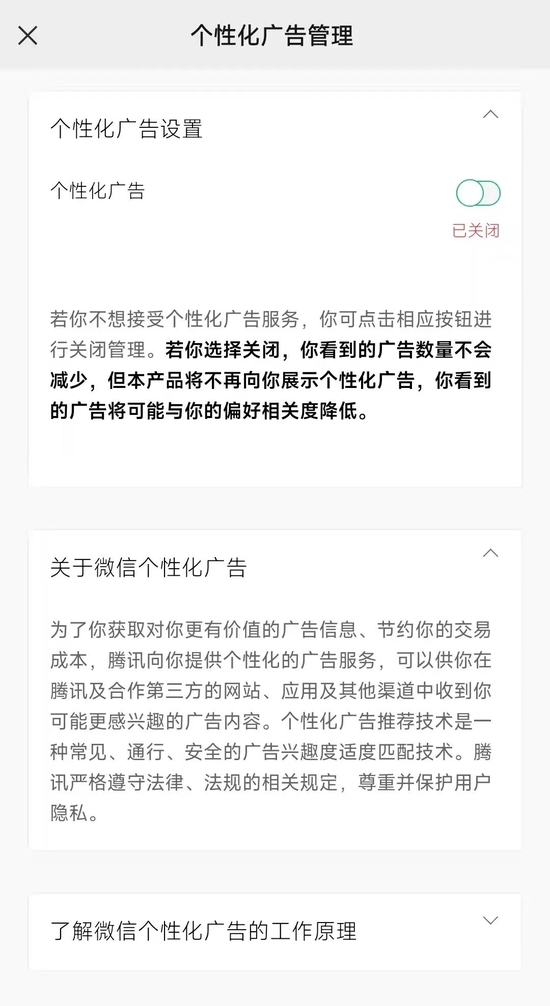

針對用戶面對算法的無奈地位,規(guī)定也要求:要向用戶提供便捷的關(guān)閉算法推薦服務(wù)選項。我關(guān)注到最新的消息是,截止到 3 月 15 日,微信、抖音、今日頭條、淘寶、百度、大眾點評、微博、小紅書等 App 均已上線算法關(guān)閉鍵。

微信個性化廣告關(guān)閉頁面

開始執(zhí)行的新規(guī)中,算法備案是一個值得關(guān)注的點。它要求算法服務(wù)提供者從內(nèi)部打開算法黑箱、增加透明度,通過輸出、建檔、留存的方式,備案系統(tǒng)將成為可溯源存案。

3 月 1 日“互聯(lián)網(wǎng)信息服務(wù)算法備案系統(tǒng)”已經(jīng)上線了,現(xiàn)在即便是普通用戶,也可以到算法備案的官網(wǎng)上去查詢一下,這在一定程度上賦予了普通用戶對于算法問題關(guān)注、討論、監(jiān)督的權(quán)利。

隨著各項法規(guī)的出臺,國內(nèi)對于算法的“規(guī)范之網(wǎng)”正逐漸編織成型。與此同時,治理主體的分層定位也更加明確了。

國家網(wǎng)信部門負(fù)責(zé)統(tǒng)籌協(xié)調(diào)治理與監(jiān)督管理工作,電信、公安和市場監(jiān)管等聯(lián)合成為治理主體,地方與之相對應(yīng)的部門負(fù)責(zé)本行政區(qū)的相關(guān)工作。算法推薦服務(wù)的提供者要配合管理部門開展安全評估和監(jiān)督檢查工作,提供必要的技術(shù)、數(shù)據(jù)等支持和協(xié)助。

或者我們更可以把算法看做是網(wǎng)絡(luò)社會中那條看不見的『關(guān)系線』,在經(jīng)由算法所構(gòu)成的治理之網(wǎng)上,不同層次、領(lǐng)域、來源的力量被召喚出來,進(jìn)入到這張治理之網(wǎng)中,發(fā)揮不同的作用。比如平臺和大型科技公司需要落實自身的責(zé)任,更多地與相關(guān)部門合作;公眾也可以運用當(dāng)下所擁有的權(quán)利,對于科技公司采用的算法進(jìn)行監(jiān)督。

對于算法治理的未來,可以將其看作是一個多元行動者的網(wǎng)絡(luò),治理會趨于規(guī)范和穩(wěn)定,但是不會停止。

疑慮:算法黑箱真的

能夠被治理嗎?

劉鵬:《計算廣告》公眾號作者

我不否認(rèn)近年來出臺的法規(guī)政策在一定程度上具有其正面意義,但是對于這類法規(guī)能夠具體起到的效果,我是存有疑慮的。

算法,真的不是那么容易就能監(jiān)管好的。

我在清華畢業(yè)以后,先在微軟亞洲研究院工作了一段時間,研究人工智能,之后又去了多家互聯(lián)網(wǎng)公司做計算廣告。一個明顯的體會就是,現(xiàn)在大型的互聯(lián)網(wǎng)公司應(yīng)用的算法,它的不可解釋性越來越強(qiáng)。

“機(jī)器學(xué)習(xí)”是目前算法推薦的主流實現(xiàn)形式,其學(xué)習(xí)的原始素材來自于每個用戶的基礎(chǔ)信息,比如性別、年齡、學(xué)歷等等,以及用戶在使用過程中產(chǎn)生的使用數(shù)據(jù),比如點贊、收藏、關(guān)注等等,用戶的每一類信息被稱為“feature”特征。

最簡單的一類算法是線性回歸算法,在這類算法中,用戶每項特征所占的權(quán)重是清晰可見的,因此其具有“可解釋性”,監(jiān)管難度并不高。

但問題在于,簡單的算法能夠解決的問題十分有限,為了提升效率,越來越多的互聯(lián)網(wǎng)公司采用的是更為復(fù)雜的深度學(xué)習(xí)算法網(wǎng)絡(luò)。

很多人會用“煉金術(shù)”來形容深度學(xué)習(xí)。

在古代,煉金師們會將收集來的各種材料一股腦地倒進(jìn)火爐中,一段時間后再看看是否煉制出了黃金,他們并不知道煉制的過程中這些材料發(fā)生了怎樣的化學(xué)反應(yīng),只能通過不斷嘗試材料組合與煉制流程。

與之類似,算法工程師們將各種可用的數(shù)據(jù)信息,都放到復(fù)雜的深度學(xué)習(xí)模型中進(jìn)行訓(xùn)練,即便他們找到了更高效的算法模型,也并不能解釋清楚這些數(shù)據(jù)之間經(jīng)過了怎樣的運算與處理。

在這種情況下,很難說清究竟是哪個特征對于算法輸出的結(jié)果具有關(guān)鍵性的影響,算法的運作過程成為了難以解釋的“黑箱”,其中隱含的問題也就難以修正。

去年 8 月《推薦算法規(guī)定》征求意見稿剛發(fā)布時,我就曾在自己的視頻號上從技術(shù)角度進(jìn)行了解讀。

我覺得大家首先要理解的一個點是,算法的世界與人類世界在組織方式上有很大的不同。

比如我們?nèi)祟愒趯W(xué)習(xí)圍棋的時候,是先學(xué)習(xí)定式、棋理,融匯貫通之后棋力提升了自然就會贏棋。但是算法學(xué)習(xí)的過程是相反的,它會先立下一個目標(biāo)——“我要贏棋”,在算法中我們稱這個目標(biāo)為“目標(biāo)函數(shù)”,然后再調(diào)用一切可以運用的數(shù)據(jù)去實現(xiàn)這個目標(biāo)。

在通向這個目標(biāo)的過程中,即使你設(shè)置了諸多障礙,復(fù)雜的算法網(wǎng)絡(luò)也會繞過這些限制,通過其他的方式達(dá)成目標(biāo)。

因此,在算法的世界中最重要的其實是那個“目標(biāo)函數(shù)”。

假設(shè)一家公司的“目標(biāo)函數(shù)”是要優(yōu)化用戶的留存時間,那么即使進(jìn)行了限制時間等防沉迷設(shè)置,算法模型還是會采取別的途徑來提升用戶在平臺上的使用時長。

“目標(biāo)函數(shù)”才是算法治理的“命門”所在,但這一點經(jīng)常會被各國的立法者所忽視。

現(xiàn)在的規(guī)定只是要求公司以“適當(dāng)?shù)姆绞焦妓惴ㄍ扑]服務(wù)”,但并未對什么是“適當(dāng)?shù)摹弊鞒鱿拗啤?/p>

如果有些公司在公布算法時,只選擇性地公布算法在關(guān)鍵環(huán)節(jié)上的特征,看起來是做到了公平、透明,但由于你不知道它真實制定的目標(biāo)函數(shù)是什么,這種公開的作用就十分有限了,甚至可能根本就沒用。

與此同時,公開算法的背后還涉及到另一個問題:一些算法對于公司或者商業(yè)機(jī)構(gòu)而言,與其商業(yè)機(jī)密有關(guān)。

商業(yè)機(jī)密是受到法律保護(hù)的,那么我們?nèi)绾稳ソ缍男┧惴☉?yīng)當(dāng)被公布、哪些算法應(yīng)當(dāng)被保護(hù)呢?如何在不使企業(yè)的商業(yè)機(jī)密受損的前提下,最大可能實現(xiàn)有意義的算法透明,還有很多問題仍需進(jìn)一步的思考。【責(zé)任編輯/林羽】

來源:極客公園

IT時代網(wǎng)(關(guān)注微信公眾號ITtime2000,定時推送,互動有福利驚喜)所有原創(chuàng)文章版權(quán)所有,未經(jīng)授權(quán),轉(zhuǎn)載必究。

創(chuàng)客100創(chuàng)投基金成立于2015年,直通硅谷,專注于TMT領(lǐng)域早期項目投資。LP均來自政府、互聯(lián)網(wǎng)IT、傳媒知名企業(yè)和個人。創(chuàng)客100創(chuàng)投基金對IT、通信、互聯(lián)網(wǎng)、IP等有著自己獨特眼光和豐富的資源。決策快、投資快是創(chuàng)客100基金最顯著的特點。

TA的最新文章

熱門文章

精彩評論

小何華為現(xiàn)在牛的不只是設(shè)備商了,,華為的手機(jī)現(xiàn)在也是全球銷量不錯,國內(nèi)也算是老大了,之前用小米,,現(xiàn)在都改華為了。。產(chǎn)品確實不錯。

小何華為現(xiàn)在牛的不只是設(shè)備商了,,華為的手機(jī)現(xiàn)在也是全球銷量不錯,國內(nèi)也算是老大了,之前用小米,,現(xiàn)在都改華為了。。產(chǎn)品確實不錯。 小何三星手機(jī)在中國還有市場嗎?看看現(xiàn)在滿大街的vivo和oppo ,,華為,,小米線下店,,就是知道三星的市場基本沒有了。。

小何三星手機(jī)在中國還有市場嗎?看看現(xiàn)在滿大街的vivo和oppo ,,華為,,小米線下店,,就是知道三星的市場基本沒有了。。 小何滴滴打車現(xiàn)在也沒有之前那么火了,,補(bǔ)貼也少了。。

小何滴滴打車現(xiàn)在也沒有之前那么火了,,補(bǔ)貼也少了。。來自: 【人物】滴滴創(chuàng)始人程維回顧與Uber競爭:中國互聯(lián)網(wǎng)從來沒有輸過--IT時代網(wǎng)

小何今日頭條要把騰訊的地方各頻道給霸占了。。

小何今日頭條要把騰訊的地方各頻道給霸占了。。來自: 少年頭條對壘中年騰訊:解局兩代互聯(lián)網(wǎng)公司商業(yè)之戰(zhàn)--IT時代網(wǎng)